센서 기술의 발전으로 인해 우리는 더 많은 데이터를 수집하고 활용할 수 있게 되었습니다. 이전에는 하나의 센서가 한 가지 종류의 데이터를 측정하는 역할을 했지만, 최근에는 더 많은 정보를 얻기 위해 다양한 센서를 사용하는 것이 필요합니다.

예를 들어, 스마트 시티, 자율주행차, 로봇 공학, 의료 등에서는 여러 가지 데이터를 동시에 수집하여 환경을 모니터링하거나 결정을 내리는 것이 중요합니다.

이러한 배경으로 멀티 센서 기술은 다양한 분야에서 활용되고 있으며, 더 나은 데이터 수집과 분석을 위한 핵심 기술로 인정받고 있습니다.

멀티 센서란?

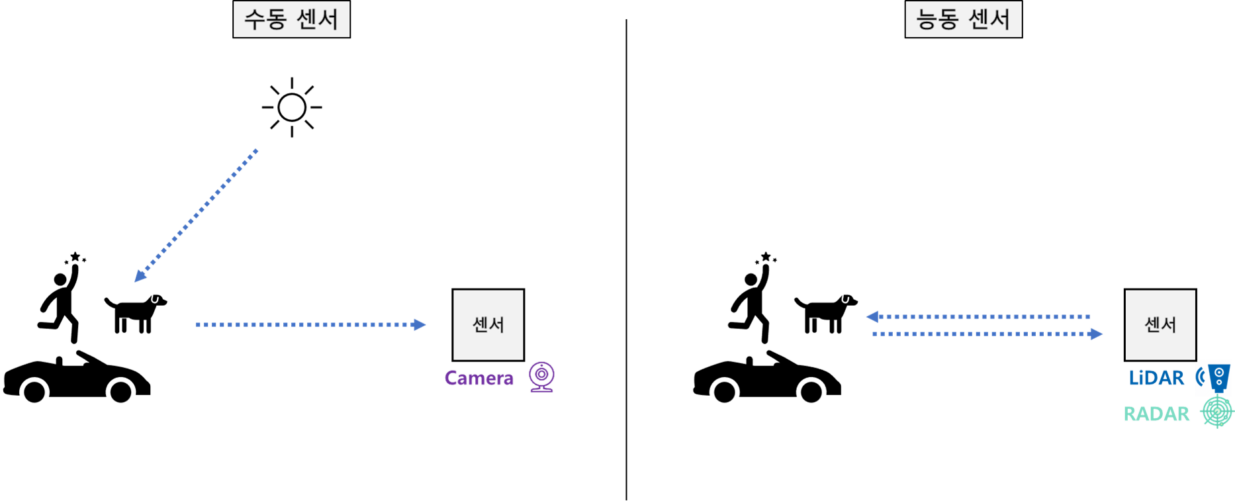

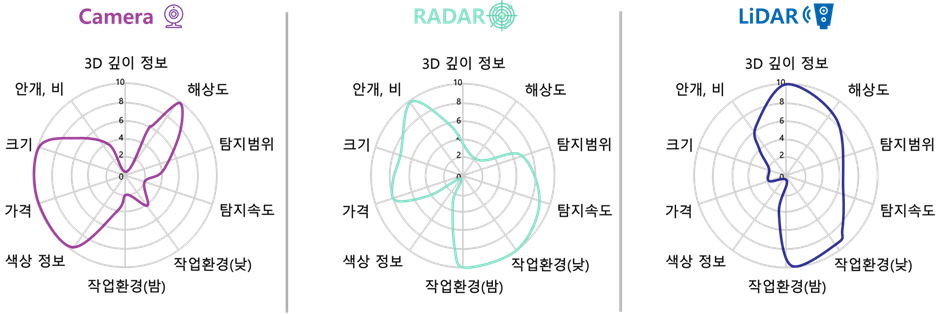

센서는 능동 센서와 수동 센서로 구분되며, 능동 센서는 에너지를 발생시켜 환경을 탐지하고, 수동 센서는 주변 환경에서 발생한 에너지를 감지합니다. 멀티 센서는 능동 센서, 수동 센서를 아우르는 다양한 종류의 센서를 결합하여 정보를 수집하고 처리하는 장치로, 센서 퓨전을 통해 정확하고 신뢰할 수 있는 데이터를 제공합니다. 이 중에서 카메라, 레이더(RADAR), 라이다(LiDAR)는 멀티 센서에 주로 사용되는 센서입니다.

카메라(Camera) : 카메라 센서는 시각적인 정보를 수집하기 위해 사용됩니다. 이미지나 비디오를 촬영하여 빛의 강도와 색상을 감지합니다. 주로 컴퓨터 비전, 영상 처리, 패턴 인식 등의 분야에서 사용되며, 객체 탐지, 추적, 인식에 활용될 수 있습니다.

레이더(RADAR) : 레이더는 “RAdio Detection And Ranging”의 약자로, 무선 신호를 사용하여 물체를 감지하는 센서입니다. 레이더 센서는 라디오파를 발사하고, 이를 반사한 신호를 수신하여 대상물의 위치와 속도 등을 측정합니다. 주로 기상청의 날씨 관측, 항공/해상 트래픽 관리, 군사용 등에 사용되며, 장거리 감지, 속도 측정, 항법 등에 활용됩니다.

라이다(LiDAR) : 라이다는 “Light Detection And Ranging”의 약자로, 빛을 사용하여 거리를 측정하는 센서입니다. 센서는 레이저 빔을 발사하고, 빔이 대상물에 반사된 후 돌아오는 시간을 측정하여 거리를 계산합니다. 이를 통해 주변 환경의 거리 정보를 정밀하게 파악할 수 있습니다. 자율주행차, 로봇, 지형 맵핑 등에 활용되며, 물체 탐지, 장애물 회피, 3D 지형 생성 등에 사용됩니다.

출처: Caesar, Holger, et al. “nuscenes: A multimodal dataset for autonomous driving.” Proceedings of the IEEE/CVF conference on computer vision and pattern recognition. 2020.

출처: SOS LAB, “자율주행 차량용 라이다 센서 기술 동향”. 오토저널 (2023)

멀티 센서 시스템에서는 다양한 종류의 센서들이 각자의 특징과 한계를 가지고 동작합니다. 센서마다 측정 방식이나 민감도 등이 다르기 때문에 단일 센서로만 데이터를 수집하면 제한된 정보만을 얻을 수 있습니다.

멀티 센서를 함께 활용하는 센서 퓨전

센서 퓨전은 신뢰성과 강인성을 향상시키기 위해 다수의 센서를 결합하여 정보를 취득하는 기술입니다. 이는 단일 센서에 의존하는 것보다 더욱 정확하고 안정적인 결과를 얻을 수 있게 해줍니다.

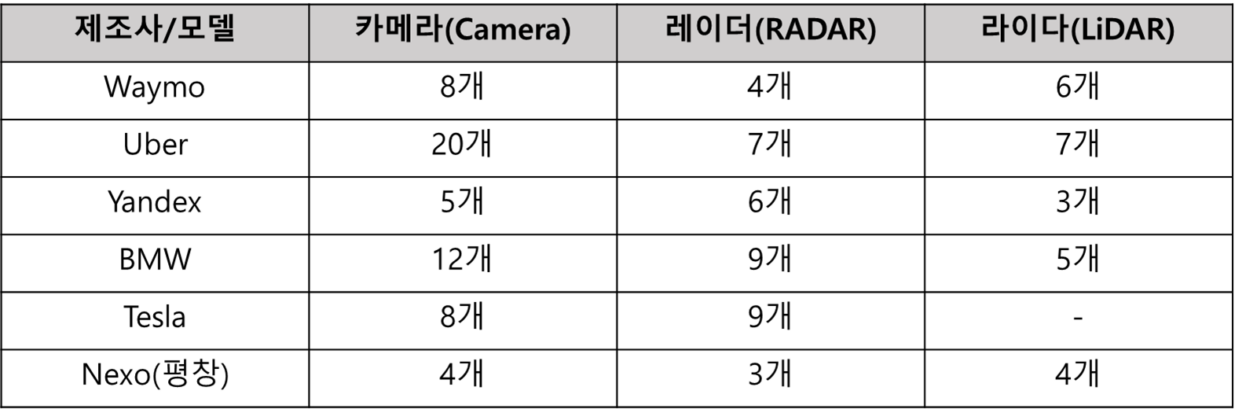

따라서 센서 퓨전은 다양한 센서들이 측정한 데이터를 통합하고 분석하여 최종적으로 정확한 상태 추정 및 결정을 내리는 것을 목표로 합니다. 예를 들어 자율 주행 자동차에서는 라이다, 카메라, 레이더 등 다양한 센서들이 사용됩니다. 각 센서는 차량 주변의 환경을 감지하고 정보를 제공합니다. 이때 센서 퓨전 기술을 사용하면, 라이다가 장애물을 감지하지 못하는 경우에도 카메라와 레이더의 데이터를 활용하여 장애물을 식별하고 안전한 주행 판단을 내릴 수 있습니다.

실제로 자율 주행 분야에서 여러 기업들은 센서 퓨전 기술을 도입하여 더욱 정확하고 신뢰성 높은 주행 인식 및 판단을 구현하고자 하였습니다. 센서 퓨전을 통해 다양한 센서들이 상호 보완하며 주행 환경을 실시간으로 이해하고, 안전하고 효율적인 자율 주행 시스템을 구현하는 데에 기여하고 있습니다.

센서 퓨전 기술은 자율 주행 뿐만 아니라 로봇 공학, 환경 모니터링, 보안 시스템, 의료 진단, 화재 탐지, 자연재해 예측, 스마트 홈 및 스마트 시티 등 다양한 분야에서 활용됩니다. 따라서 세계 시장에서도 센서 퓨전 기술에 대한 수요가 지속적으로 증가하고 있습니다. 실제로 IMARC (International Market Analysis Research and Consulting) Services Private Limited[1]에서 조사한 바에 의하면 2021년에는 센서 퓨전 시장이 46억 달러에 이르렀으며, 2022년부터 2027년까지 연평균 복합 성장률(CAGR) 19.50%가 예상됩니다. 이는 센서 퓨전 기술의 중요성과 잠재적 가치가 인식되고 있다는 것을 보여줍니다.

* [1]: IMARC Services Private Limited, “센서 융합 시장 : 세계 업계 동향, 점유율, 규모, 성장, 기회, 예측(2022-2027년)”

출처: 황재호. “자율주행을 위한 센서기술동향.” 오토저널 (2020)

센서 퓨전을 어떻게 하는지?

이전까지는 센서 퓨전의 필요성에 대해 살펴보았다면, 이제는 센서 퓨전 기술을 구현하는 실질적인 방법에 대해서 알아보도록 하겠습니다.

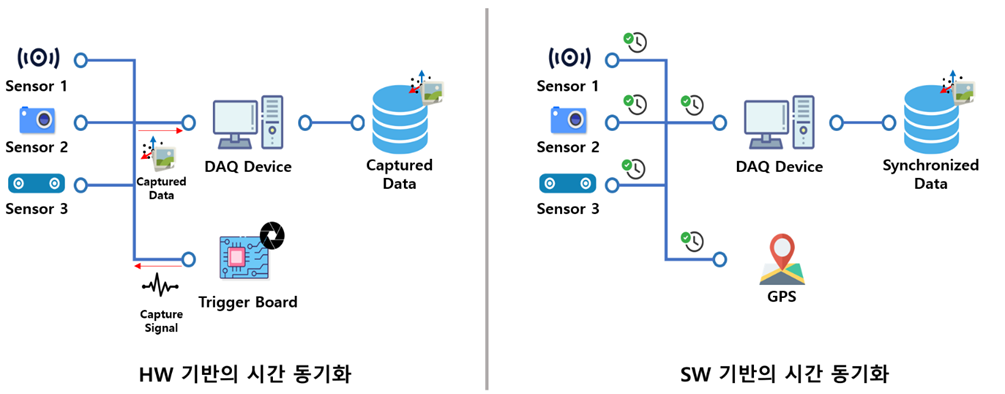

먼저, 정확한 센서 퓨전을 위해서는 센서들의 시간을 맞춰주는 시간 동기화 작업이 필요합니다. 센서들이 동일한 시간 기준으로 데이터를 수집하고 보고하는 것은 매우 중요합니다. 따라서 시간 동기화는 센서 데이터의 정합성, 실시간 응용 프로그램의 성능, 데이터 통합을 위해 필수적입니다. 시간 동기화는 하드웨어와 소프트웨어를 사용하여 달성할 수 있습니다. 하드웨어 동기화는 공유된 시계 또는 타임 스탬프 신호를 활용하고, 소프트웨어 동기화는 센서 데이터에 포함된 타임 스탬프를 사용하여 정렬하고 일치시킵니다.

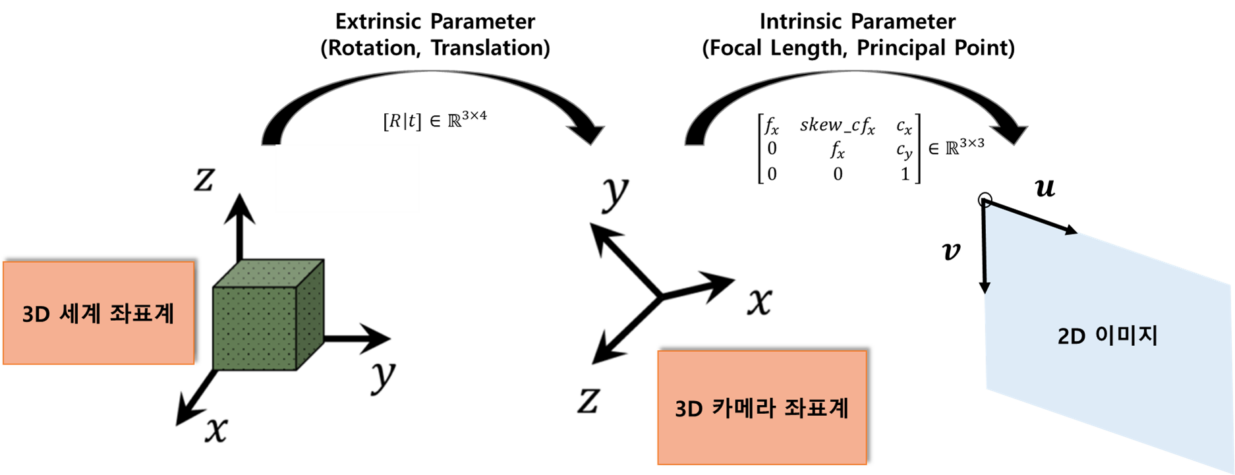

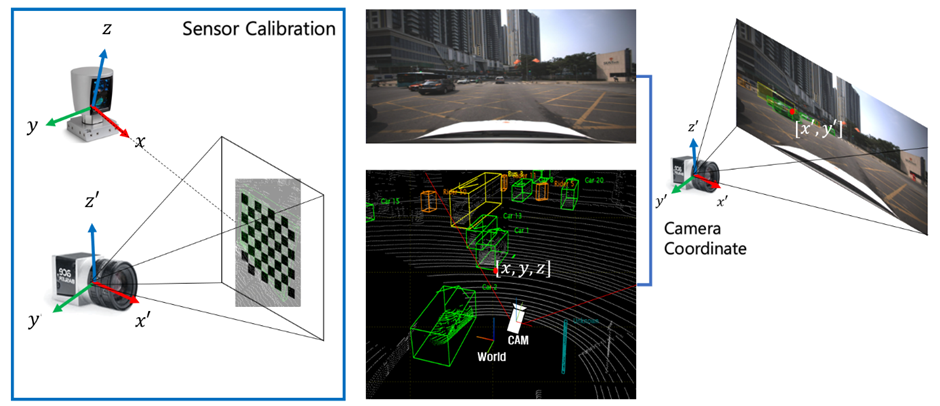

센서 시간 동기화가 완료가 되었다면 다음으로는 센서들의 좌표계를 일치시키기 위해 각각의 센서에 대한 Extrinsic Parameter와 Intrinsic Parameter를 정확하게 파악해야 합니다. 일반적으로, 카메라는 2D 이미지를 생성하는데 사용되며, 라이다는 3D 포인트 클라우드 데이터를 생성합니다. 따라서 카메라와 라이다 간에 좌표를 맞춰주기 위해서는 3D 공간의 정보를 2D 이미지로 투영하는 카메라의 Extrinsic Parameter와 Intrinsic Parameter를 추정해야 합니다. 이 과정은 카메라 Calibration을 통해 수행됩니다.

카메라 Calibration은 카메라의 물리적인 특성인 Extrinsic Parameter (Rotation, Translation)와 Intrinsic Parameter (Focal Length, Principal Point)를 추정하는 과정입니다. 이를 위해 카메라를 특정 패턴(예: 체크보드 패턴)이 있는 평면에 대해 여러 각도와 위치에서 촬영하고, 해당 이미지에서 패턴의 변형을 분석하여 카메라의 Extrinsic Parameter와 Intrinsic Parameter를 추정합니다.

이렇게 추정된 카메라 Parameter를 사용하여 카메라 이미지의 픽셀 좌표를 3D 공간의 좌표로 변환할 수 있습니다. 이와 마찬가지로, 라이다 센서로부터 수집된 3D 포인트 클라우드 데이터도 해당 센서의 Intrinsic 및 Extrinsic Parameter를 사용하여 좌표를 정확하게 맞출 수 있습니다.

그러나 카메라와 라이다의 Extrinsic parameter는 기본적으로 서로 다를 수 있으며, 센서들의 상대적인 위치 및 시점이 일치하지 않을 수 있습니다. 이를 해결하기 위해 센서 Calibration을 수행하여 카메라와 라이다의 Extrinsic Parameter를 조정하고 맞춰줍니다. 이 과정을 통해 각각의 센서 데이터가 동일한 좌표계에 맞게 정렬되며, 최종적으로 센서 퓨전을 완성할 수 있습니다. 잘 조합된 데이터를 기반으로 객체 인식, 추적, 장애물 회피 등과 같은 응용 프로그램을 구현하고, 의사 결정을 내리는데 활용할 수 있습니다.

끝으로 테스트웍스에서는

테스트웍스는 검증된 센서 시간 동기화 기술과 Calibration 기술을 기반으로 한 플랫폼을 통해 실내 및 실외 환경에서 다양한 유형의 데이터를 고품질로 취득할 수 있습니다. 최근에는 CEDI (Collect Every Data Intelligently)를 활용하여 스마트한 멀티모달 데이터 수집 플랫폼의 성능을 더욱 향상시키고 있습니다. 이를 통해 테스트웍스는 정확하고 효율적인 데이터 관리 및 분석을 지원하며, 다양한 응용 분야에서 활용할 수 있는 솔루션을 제공합니다.

권혁준

연구원, AI 연구 개발팀

충남대학교 전자공학과 학/석사

충남대학교 통신 및 신호처리 연구실에서 인공지능 기반의 다양한 컴퓨터 비전 연구와 프로젝트를 진행하였으며, 국내 외 저명한 학회 및 저널에 논문을 개제한 경험이 있다. 현재 테스트웍스 AI 연구 개발팀에서 사람 재 식별, Tracking 등을 연구하고 있으며 최근에는 인공지능 데이터 자동화 및 자동 검수 툴 개발 연구를 진행하고 있다.